1. September 2017

„I got a feeling, you’re fooling“: eine Vertrauensfrage von Marlies Wirth anlässlich der Ausstellung Hello, Robot.

Vertrauen ist keine Frage der Technik, sondern eine gesellschaftliche Entscheidung. Wenn wir Aufgaben an Maschinen und Roboter delegieren, heißt das automatisch, dass wir ihnen vertrauen. Vertrauen in Roboter setzt jedoch voraus, dass diese auf dem Verständnis derselben sozialen bzw. ethischen Grundsätze als Basis für eine Entscheidungsfindung aufbauen wie Menschen.[1]

Vertrauen kann als ein Zustand bezeichnet werden, der in einem Beziehungsgeflecht zwischen Menschen entsteht und umgekehrt: der es überhaupt ermöglicht, ein solches aufzubauen. Vertrauen spielt sich in der Grauzone zwischen Wissen und Nicht-Wissen ab und beschreibt – ähnlich wie das Zweifeln – ein Gefühl, das ein Handeln trotz fehlender Gewissheit ermöglicht.[2] Wir schreiben der Person, der wir vertrauen, Verantwortung zu und können sie im Fall des Vertrauensmissbrauchs „verantwortlich machen“. Doch trifft das auch auf einen Roboter bzw. einen „nichtmenschlichen Aktanten“ zu?

Drei unterschiedliche Projekte in der im Rahmen der VIENNA BIENNALE 2017 gezeigten Ausstellung Hello, Robot. Design zwischen Mensch und Maschine (Eine Ausstellung des MAK, des Vitra Design Museums und des Design museum Gent) verdeutlichen, dass Vertrauen in Technologie sowohl notwendig als auch riskant sein kann. Die Vertrauensfrage setzt ein System voraus, das nicht kapitalistisch korrumpiert ist – doch dazu wären ein weitgreifender Umbau politischer Strukturen und die Etablierung eines neuen kulturellen Bewusstseins nötig. Die Frage nach dem Vertrauen in die Technologie ist also weitgehend eine Frage nach dem Vertrauen in die Menschen.

Selbstfahrende Fahrzeuge

Matthieu Cherubini (automato.farm),

Ethical Autonomous Vehicles, 2015

Video, 6:59 Min.

© automato.farm

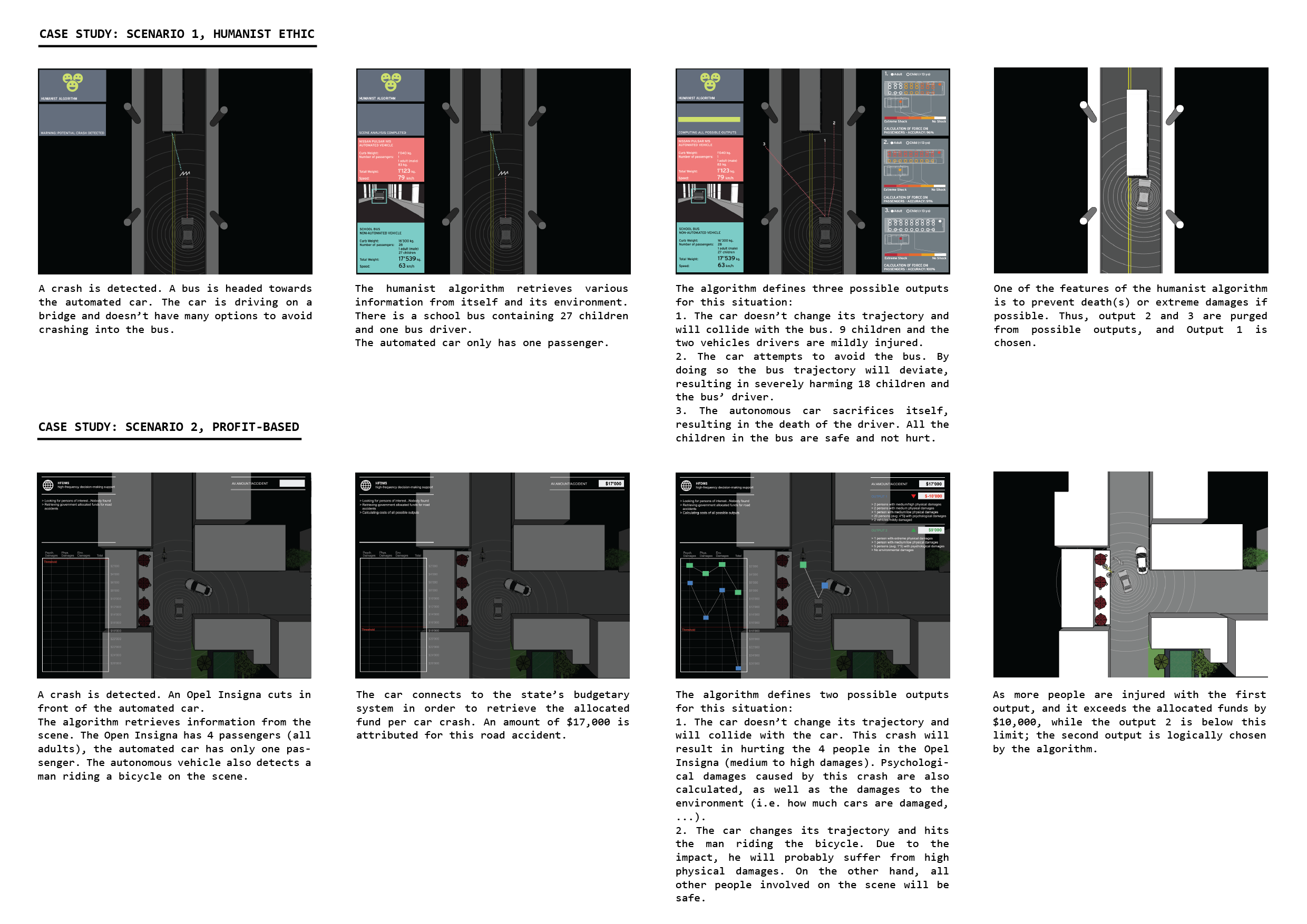

Prognosen behaupten, dass der Verkehr mit selbstfahrenden Fahrzeugen sicherer sein wird als heute. Doch selbst wenn das stimmt, werden auch diese Fahrzeuge in Situationen geraten, die moralische und ethische Konflikte mit sich bringen. Das moralische Dilemma, ob im Fall eines unausweichlichen Unfalls die InsassInnen des Fahrzeugs, Kinder oder alte bzw. sozial schlechter gestellte Menschen bevorzugt werden sollten, kommt dem Gedankenexperiment des „Trolley Problems“ (auch: „Weichenstellerfall“) nahe. Eine „richtige“ Entscheidung ist quasi unmöglich. Auf welcher Grundlage soll man dem autonomen Fahrzeug also vertrauen? Das Video Ethical Autonomous Vehicles simuliert Unfallszenarien auf Basis von drei verschiedenen Algorithmen, die jeweils einer bestimmten ethischen Position folgen: humanistisch (soziale und menschliche Kosten minimieren), profitbezogen (monetäre Kosten minimieren) und schützend (Gefahr für die Insassen minimieren). Vor Augen geführt wird letztlich, dass solche Systeme immer ideologische Positionen widerspiegeln. Der Output der verschiedenen Szenarien kann dann etwa so aussehen.

automato.farm

Eine Studie des MIT – Massachusetts Institute of Technology lässt BesucherInnen einer Website unter dem Titel Moral Machine testen, welche moralischen Entscheidungen ein selbstfahrendes Auto (bzw. im Moment noch dessen menschliche ProgrammiererInnen) treffen können muss. Versuchen Sie es selbst!

Mit dem Roboter auf Tuchfühlung: Der knife.hand.chop.bot

5VOLTCORE, knife.hand.chop.bot, 2007

Mixed-Media-Installation, ca. 53,5 × 50 × 130 cm

© Emanuel Andel

Wenn man mit dem Messer in rasendem Tempo in die schmalen Zwischenräume der gespreizten Finger sticht, ist das alles andere als angenehm. Macht man es selbst, hat man sein Schicksal bzw. das seiner Finger immerhin in der eigenen Hand – doch was, wenn ein Roboter das „Messerspiel“ kontrolliert? Der knife.hand.chop.bot ist ein Instrument, mit dem unser Vertrauen in Technologie getestet werden kann. Der oder die TeilnehmerIn spreizt die Hand, und der „Bot“ sticht in immer schnellerem Tempo zu. Doch wie sehr man auch vertraut, die unbewusste Angst triggert die selbsterfüllende Prophezeiung: Die Handflächen werden durch die Nervosität feucht und damit zum Leiter – das führt damit bei dem ansonsten auf Präzision programmierten Roboter zu immer größeren Ungenauigkeiten …

Privat vs. öffentlich

Alexander Reben, Blabdroid, 2012

Kunstprojekt, diverse Materialien,

14 × 12 × 12 cm

© Alexander Reben

Während der Mensch zunehmend „transparenter“ gemacht wird, wird die Technologie zur undurchschaubaren „Black Box“. Schon jetzt sind wir von kommunizierenden Gegenständen umgeben, die unsere Gewohnheiten studieren und alle entsprechenden Daten in die „Cloud“ schicken. Darauf zu vertrauen, dass Außenstehende auf diese Daten keinen Zugriff haben, ist unmöglich. Dabei werden wir vielfach durch spielerischen Umgang und eine vertrauenserweckende Gestaltung dazu animiert, unsere privaten Informationen preiszugeben. „Wie heißt du?“, „Findest du mich süß?“: Mit diesen einfachen Fragen bricht der vorprogrammierte Roboter Blabdroid bei völlig fremden Menschen das Eis. Am Ende vertrauen sie ihm ihre intimsten Geheimnisse, ihre peinlichsten Erlebnisse und andere Geschichten an – die streamt der winzige Blabdroid direkt auf YouTube. Mit seiner hellen Kinderstimme und den großen, weit auseinanderstehenden Augen entspricht der Blabdroid dem „Kindchenschema“ und macht es einem dadurch ungemein leicht, sich ihm zu öffnen. Der Roboter entstand im Anschluss an Boxie, Alexander Rebens Masterarbeit am MIT zum Thema Mensch-Roboter-Symbiose.

Ein Beitrag von Marlies Wirth, Kuratorin Digitale Kultur und Kustodin Sammlung Design, MAK; Kuratorin der Ausstellung Hello, Robot. Design zwischen Mensch und Maschine (Eine Ausstellung des MAK, des Vitra Design Museums und des Design museum Gent)

[1] Mark Coeckelbergh, Can we trust robots?, Springerlink.com, 2011, S. 1 http://link.springer.com/article/10.1007/s10676-011-9279-1

[2] Vilém Flusser, On Doubt [1966] (Minneapolis: Univocal, 2014), S. 3–4